Was wäre, wenn sämtliche übers Internet versendete Nachrichten öffentlich einsehbar wären? Wenn potenziell jeder auf die privaten Passwörter, Bankdaten und andere verschlüsselte Informationen zugreifen könnte? Dass dieses Szenario in der Zukunft eintreten wird, davon sind Wissenschaftler und selbst die US-Regierung überzeugt. Möglich machen könnten das die nach Science-Fiction klingenden Quantencomputer – eine derzeit noch unausgereifte Technologie, die neben Sicherheitsrisiken auch ungeahnte Möglichkeiten birgt.

Möglichkeiten, die die Aufmerksamkeit der Öffentlichkeit und vor allem der „Big Players” auf sich gezogen haben. So arbeiten derzeit Google, IBM, und viele andere Forschungseinrichtungen mit verschiedenen Ansätzen an einem Prototypen. Ihr Interesse wird von Investoren geteilt, die „Quanten-Start-Ups“ laut der Beratungsfirma McKinsey allein im letzten Jahr mit 2,35 Milliarden Dollar unterstützt haben sollen. Die Erwartungen sind groß: Bis 2035 soll die Technologie für bis zu 1,3 Billionen Dollar Gewinn in ausgewählten Industriesektoren sorgen. Der Quantencomputer ist trotz seiner derzeit noch zahlreichen Probleme zu einem großen technologischen Hoffnungsträger geworden. Doch was macht ihn so besonders im Vergleich zu einem herkömmlichen Computer?

Bitte ein Qubit

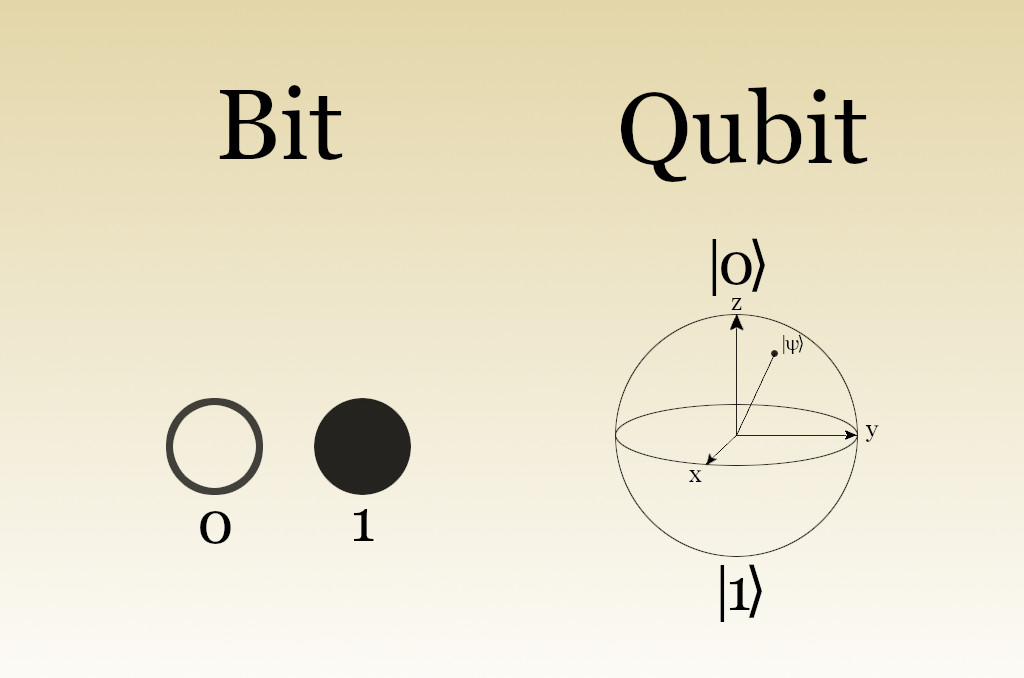

Der Hauptunterschied liegt darin, wie die Maschine Informationen verarbeitet. Bei einem herkömmlichen PC geschieht dies auf unterster Logikebene mit „Bits“. Ein Bit ist ein Datentyp, der nur zwei Werte annehmen kann: 0 und 1 beziehungsweise aus und an. Physisch umgesetzt wird dies mithilfe eines elektrischen Stromes, der durch einen oftmals mikroskopisch kleinen Schalter fließt. Ist der Fluss „stark“ genug, aktiviert der Schalter, lässt den Stromfluss durch und nimmt somit den Wert 1 an. Mit mehreren solcher Schalter – auf modernen Computerchips sind es teils mehrere Milliarden – und diversen anderen elektronischen Schaltungen lassen sich einfache Berechnungen durchführen. In Kombination mit anderen Bestandteilen des Chips und PCs erlauben sie uns so dessen heutige vielseitige Nutzung.

Visualisierung der unterschiedlichen Wertrepräsentationen zwischen Bit und Qubit. Grafik: Paul Klotzsche

Quantencomputer verwenden zwar auch Bits, aber nicht die gleichen wie traditionelle Rechner. Stattdessen verwenden sie sogenannte „Quantenbits“, meist „Qubits“ genannt, die einige nennenswerte Unterschiede zu ihren elektronischen Gegenstücken haben. So werden sie nicht durch elektronische Minischalter repräsentiert, sondern durch physikalische Teilchen wie zum Beispiel Photonen oder Elektronen. Da diese Teilchen von Natur aus den Regeln der Quantenphysik folgen, weisen sie einige außergewöhnliche Eigenschaften auf: Ein Qubit kann zwar ebenfalls einen Wert von 0 oder 1 haben, jedoch kann auch eine Überlagerung der beiden Zustände von 0 und 1 auftreten – das Qubit kann also beide Werte gleichzeitig annehmen. Dieses paradoxe Verhalten nennt sich „Superposition“ und erlaubt zusammen mit dem Prinzip der Verschränkung das – vereinfacht ausgedrückt – gleichzeitige Ausführen von mehreren Rechenschritten. Dadurch erreichen Quantencomputer bei bestimmten Berechnungen einen enormen Geschwindigkeitsvorteil gegenüber normalen Computern. Aufgaben, für die ein traditioneller Computer normalerweise Billionen an Jahren Berechnungszeit brauchen würde, könnten so in kürzester Zeit erledigt werden.

Herstellung und Eigenschaften von Qubits

Es gibt verschiedene Ansätze, Qubits herzustellen. Manche Forscher schließen ein geladenes Atom in einem elektromagnetischen Feld ein und manipulieren es anschließend mit einem Laser, um mit ihm zu rechnen. Andere nutzen winzig kleine elektrische Schaltkreise, welche sich bei knapp über 0 Kelvin wie ein Quantenobjekt verhalten und mit Mikrowellen manipuliert werden können. Unabhängig von der Implementation haben alle Arten von Qubits einige Eigenschaften, die für das Funktionieren eines Quantencomputers unerlässlich sind.

Superposition: Ein Qubit kann die Werte 0 und 1 gleichzeitig annehmen. Sobald das Qubit gemessen wird, um dessen Wert zu ermitteln, zerfällt diese Superposition allerdings und das Qubit nimmt mit einer gewissen Wahrscheinlichkeit entweder den Wert 0 oder 1 an (Dekohärenz). Diesen Wert wird es auch bei allen weiteren Messvorgängen haben. Der Akt des Beobachtens des Quantenteilchens hat also dessen Superposition beendet.

Verschränkung: Wenn mehrere Qubits miteinander verschränkt sind, beeinflussen sie sich gegenseitig und können nicht mehr unabhängig voneinander betrachtet werden. Misst man z.B. den sogenannten Spin eines verschränkten Teilchenpaares, welches einen vereinten Spin von 0 hat, so weiß man nach der Messung des Spins des einen Teilchens, dass das andere einen entgegengesetzten Spin haben muss.

Interferenz: Winzige Teilchen weisen sowohl Eigenschaften von Partikeln als auch Wellen auf. Wellen wiederum haben die Eigenschaft, sich bei einem Aufeinandertreffen gegenseitig zu beeinflussen. So können sie sich, basierend auf der Amplitude der Wellen am Treffpunkt, entweder gegenseitig verstärken oder auslöschen. Dieses Prinzip wird benötigt, um die inhärente Zufälligkeit von Qubits so zu manipulieren, dass das gewollte Ergebnis wahrscheinlicher ist.

„Für eine Vielzahl von Anwendungen interessant“

Was aber sind diese Berechnungen, die von Quantencomputern derart effizient durchgeführt werden könnten? Der am weitesten akzeptierte Anwendungsfall ist das Knacken der RSA-Verschlüsselung, die auf Berechnungen mit sehr großen Primzahlen basiert. Diese für große Teile der Internetkommunikation verwendete Verschlüsselungsmethode ist für traditionelle Computer ohne die Schlüsselzahlen praktisch nicht lösbar. Für Quantencomputer mithilfe des sogenannten Shor-Algorithmus hingegen theoretisch schon, wie Forscher von IBM bereits vor über 20 Jahren im Kleinformat demonstrierten. Jeder mit einem ausreichend starken Quantencomputer könnte sich dann freien Einblick in den Internetverkehr anderer verschaffen, egal ob beim Online-Banking, E-Mail-Verkehr, oder simplen Browsen.

Die potenziellen Anwendungsgebiete von Quantencomputern gehen aber darüber hinaus. „Wir haben eine ganze Klasse an ‚fault toleranten‘ Algorithmen“, erklärt Dr. Jeanette Lorenz vom Fraunhofer-Institut im Gespräch mit medienMITTWEIDA. Dieser „Bausatz an Algorithmen“ sei die Grundlage für die Einbettung des Quantencomputers in kompliziertere, von klassischen Computern gesteuerte Berechnungsalgorithmen, die beispielsweise für eine Beschleunigung von maschinellen Lernalgorithmen sorgen könnten – vorausgesetzt, diese Einbettung und der damit einhergehende Konvertierungsschritt zwischen den beiden Teilen ist schnell genug: „Man muss den ganzen Prozess sehr effizient gestalten, damit man den Rechenvorteil des Quantencomputers nicht verliert“, so Lorenz.

Sollte dies jedoch gelingen, könnten Quantencomputer eines Tages nicht nur maschinelles Lernen beschleunigen, sondern auch für akkuratere Simulationen von Molekülen und für Optimierungsprobleme eingesetzt werden. Anwendungen, die für den Laien erstmal uninteressant wirken, jedoch sehr greifbare Konsequenzen mit sich führen könnten: „Wenn ich die Moleküle, die für Medikamente entscheidend sind, effizienter simulieren kann, dann heißt das, dass ich schneller und kostengünstiger zu einer klinischen Studie komme.“ Ebenso könnten Optimierungsalgorithmen zum Beispiel für die Routenoptimierung bei Logistikunternehmen genutzt werden. Ähnlich zu künstlichen Intelligenzen würde der Einsatz eines Quantencomputers zwar hinter einer Abstraktionsebene geschehen und somit keine einschneidende Veränderung im Alltag mit sich bringen, doch es sei „natürlich für eine Vielzahl von Anwendungen interessant, wenn gewisse Eigenschaften effizienter ausgerechnet werden könnten.“

Technische Startschwierigkeiten

Aber auch wenn Quantencomputer in Zukunft zu großen Fortschritten in verschiedensten Bereichen führen könnten, so steht die Technologie noch vor großen technischen Herausforderungen. Beispielsweise erweist es sich als schwierig, die Quanteneigenschaften eines Qubits, die essenziell zur Funktionsweise der Maschinen sind, aufrechtzuerhalten. Interaktion zwischen dem Teilchen und seiner Umgebung führt zu einem Verlust von Quanteninformationen, was wiederum die durchgeführten Berechnungen ungenauer macht. Diese Interaktionen können zum Beispiel mit kosmischen Strahlen, die auf die Teilchen treffen, oder auch mit anderen durch Wärme angeregten Atomen stattfinden. Letzteres ist der Grund, weshalb viele Quantencomputer aufwendig auf knapp über den Nullpunkt heruntergekühlt werden müssen. Aber nicht nur die Dauer, für die Qubits in einer Superposition gehalten werden können, ist derzeit unzureichend, sondern auch deren Menge: Um beispielsweise die bereits erwähnte RSA-Verschlüsselung zu knacken, bräuchte ein Quantencomputer mehrere Millionen physische Qubits – der Rekord liegt derzeit bei 1180 Qubits.

Wettrennen um die Quantenüberlegenheit

So groß, wie die Herausforderungen derzeit sind, so begrenzt ist die Brauchbarkeit von aktuellen Quantencomputern. Es gibt zwar einige spezialisierte Geräte wie die Quantenannealer, die bereits jetzt tatsächlich auftretende Finanz- und Logistikprobleme lösen können. Universelle Quantencomputer, die für beliebige Aufgaben programmiert werden können, bearbeiten derzeit aber nur Test-Aufgaben. Selbst Googles „Sycamore“, dessen Entwickler 2019 medienwirksam behaupteten, den Meilenstein der Quantenüberlegenheit erreicht zu haben, konnte dies nur mit einem extra für dessen Stärken entwickelten Versuchsaufbau schaffen. Zudem hatte das gelöste Problem keinen praktischen Nutzen und könne, laut Behauptungen des Konkurrenten IBM, auch auf einem klassischen Computer relativ schnell gelöst werden. Das Wettrennen nach der praktischen Quantenüberlegenheit und dem damit einhergehenden Vorteil gegenüber normaler Computer läuft also weiter.

Quantenüberlegenheit

Ein Quantencomputer demonstriert Quantenüberlegenheit, wenn er eine Aufgabe löst, die kein herkömmlicher Computer in einer plausiblen Zeitspanne bewältigen könnte. Diese Aufgabe muss keinen praktischen Nutzen haben.

Derzeit noch Zukunftsmusik

Die Technologie steckt noch in ihren Kinderschuhen und die Geschwindigkeit sowie Art künftiger Entwicklungen sind schwer abzuschätzen. Mit Blick auf die Zukunft verweist Dr. Jeanette Lorenz auf die sogenannte „Quantum Utility“ – die Eigenschaft, dass ein Quantencomputer ein Problem in etwa so schnell lösen kann wie ein klassischer Computer -, die IBM laut eigener Aussage dieses Jahr erreichte. Sie geht davon aus, dass „wir in den nächsten Jahren zunehmend solche Beispiele sehen werden, wo es nicht mehr so eindeutig auseinander zu differenzieren ist, ob der klassische oder der Quantencomputer besser ist.“ Ein potenzieller Quantenvorteil würde sich erst in einer konkreten, nützlichen Anwendung feststellen lassen.

Wann es einen universellen und skalierbaren Quantencomputer geben wird, kann niemand mit Sicherheit sagen. „Die für logische Berechnungen benötigten Verbesserungen sind so erheblich, dass jede Schätzung, wann diese erreicht sein werden, […] grob ungenau sein würde“, wie sich die Wissenschaftler der „National Academies of Sciences, Engineering, and Medicine“ in ihrem Bericht einig sind. Auch wenn die potenziellen Vorteile dieser neuen Technologie also herausragend sein könnten, so müssen wir noch eine ganze Weile auf sie warten. Bis dahin wird der universelle Quantencomputer erst einmal Science-Fiction bleiben.

Text, Titelbild, Grafik: Paul Klotzsche